Cloud-native đang bước vào phase mới: khi platform engineering gặp AI

Bài chia sẻ của Nguyễn Đạt - MRE (Market Research Expert) tại VNPT Cloud.

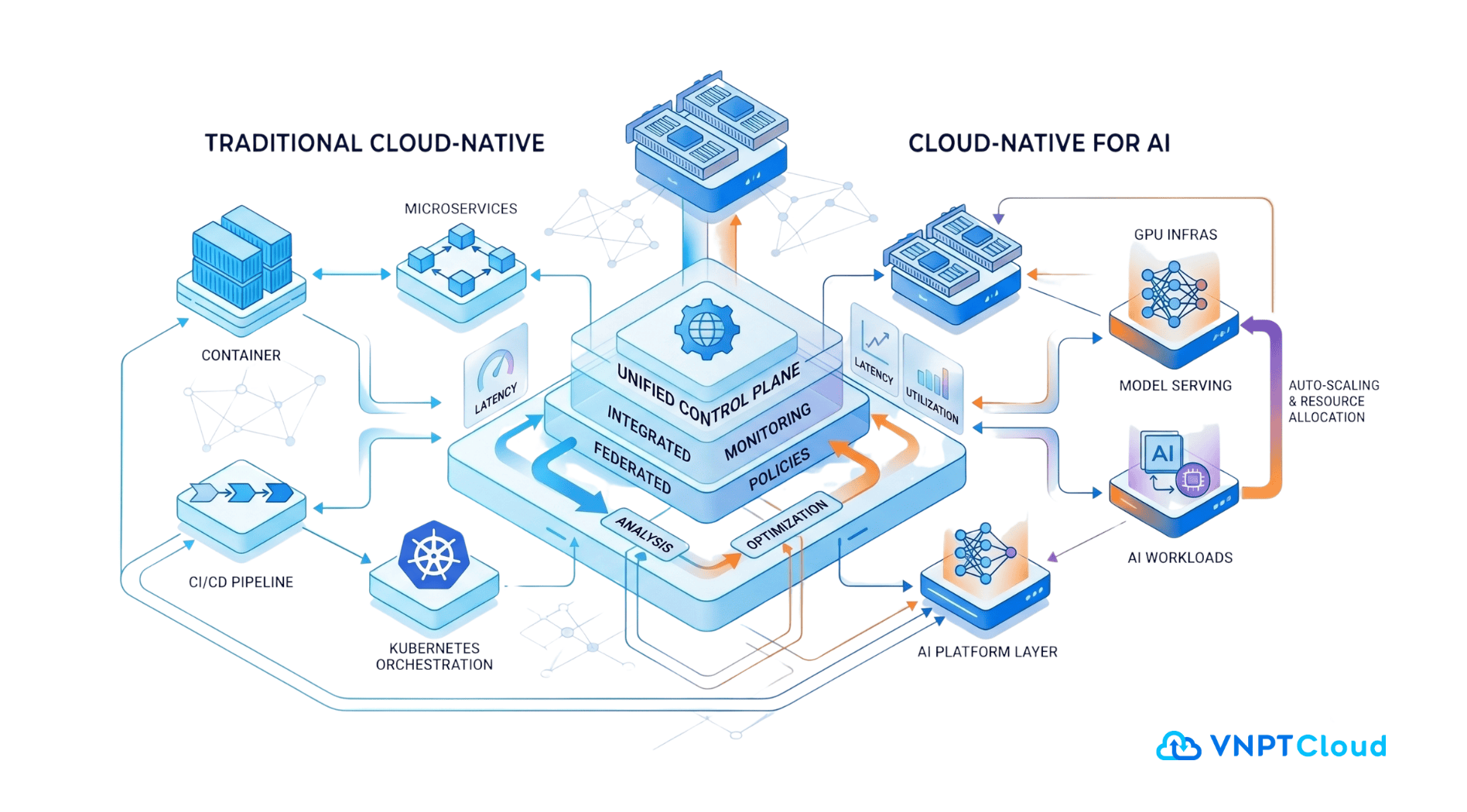

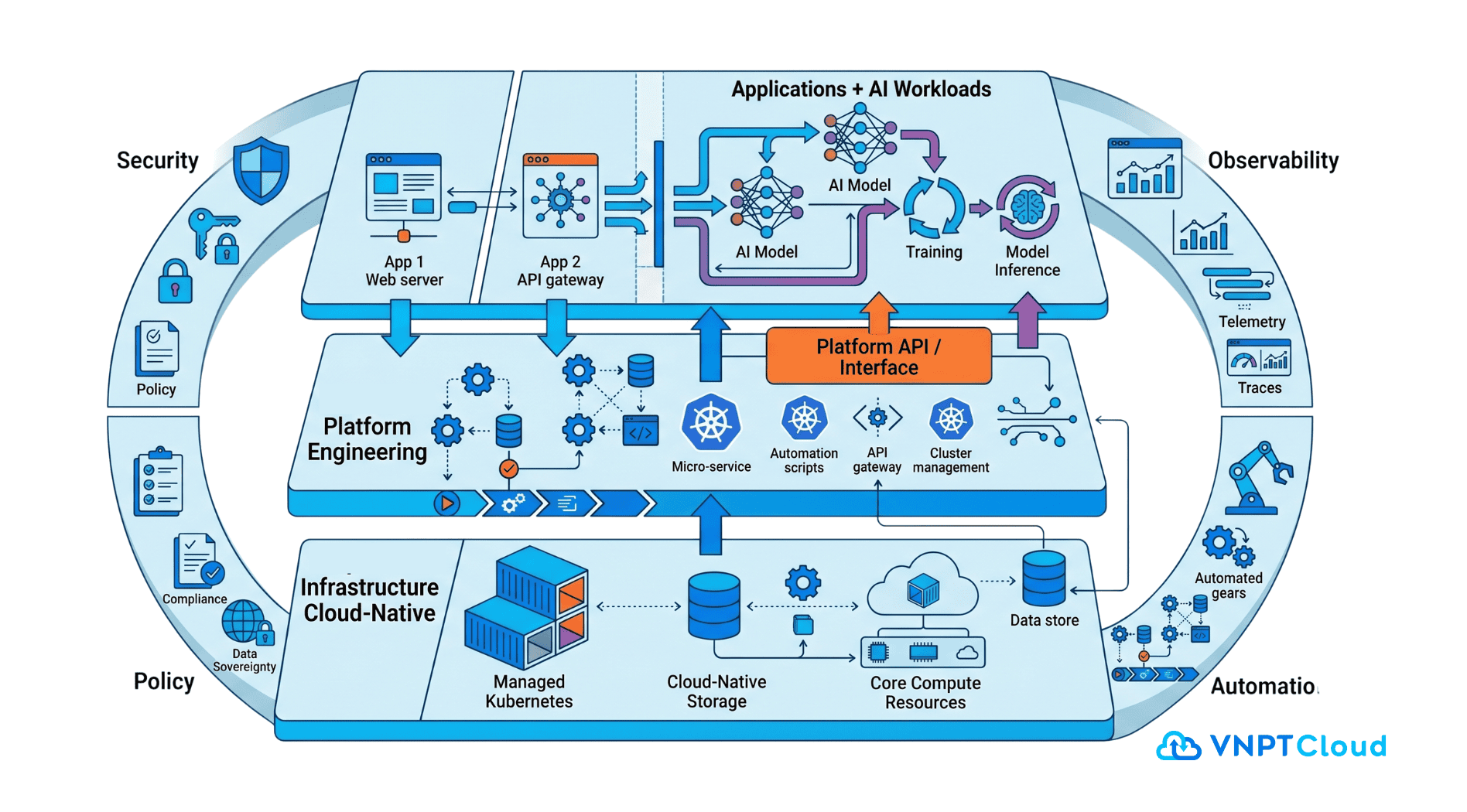

Nếu cách đây vài năm, cloud-native chủ yếu được nhắc đến cùng Kubernetes, container và microservices, thì đến năm 2026, câu chuyện đã khác. Cloud-native không còn chỉ là cách triển khai ứng dụng hiện đại, mà đang trở thành nền tảng để doanh nghiệp vận hành AI ở quy mô thật. Và chính tại điểm giao đó, platform engineering đang nổi lên như lớp hạ tầng mới giúp doanh nghiệp kiểm soát độ phức tạp, chuẩn hóa trải nghiệm developer và đưa AI vào production theo cách bền vững hơn.

Cloud-native không còn chỉ là câu chuyện của Kubernetes và container

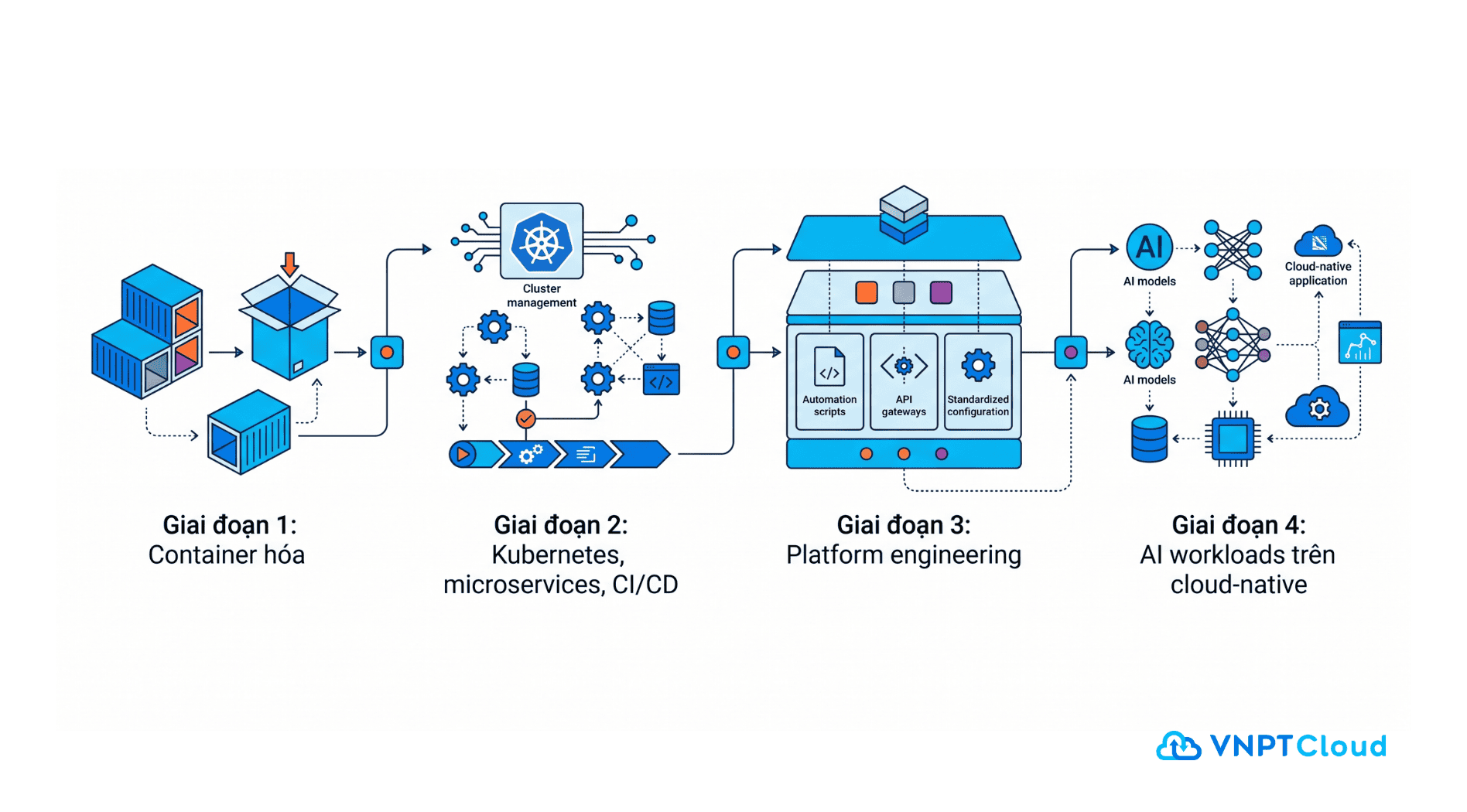

Trong giai đoạn đầu của cloud-native, trọng tâm của phần lớn doanh nghiệp là container hóa ứng dụng, triển khai CI/CD, chuẩn hóa microservices và đưa workload lên Kubernetes. Nhưng đến năm 2026, trọng tâm đã dịch chuyển. CNCF và SlashData cho biết cộng đồng developer cloud-native toàn cầu đã đạt khoảng 19,9 triệu người, tương đương gần 39% tổng số developer trên thế giới. Điều đáng chú ý hơn là 7,3 triệu developer AI hiện cũng là cloud-native developer, cho thấy AI không còn đứng ngoài hệ sinh thái này nữa mà đang đi thẳng vào bên trong nó.

CNCF (Cloud Native Computing Foundation) là một tổ chức phi lợi nhuận thuộc Linux Foundation, thành lập năm 2015 nhằm thúc đẩy công nghệ điện toán đám mây gốc (cloud-native). CNCF quản lý và hỗ trợ các dự án mã nguồn mở phổ biến như Kubernetes, Prometheus, giúp phát triển ứng dụng linh hoạt, khả năng mở rộng cao trên Cloud.

Sự thay đổi đó kéo theo một câu hỏi mới. Ngày hôm nay, vấn đề không còn là “doanh nghiệp đã dùng Kubernetes chưa”, mà là “doanh nghiệp đã biến cloud-native thành một nền tảng nội bộ đủ tốt để nhiều nhóm cùng sử dụng hay chưa”. Cũng theo CNCF, 82% người dùng container hiện đã chạy Kubernetes trong production, và 66% tổ chức đang host generative AI dùng Kubernetes cho một phần hoặc toàn bộ inference workloads. Điều này cho thấy Kubernetes đang đi từ vai trò “công cụ hiện đại hóa ứng dụng” sang vai trò “nền điều phối chung” cho cả ứng dụng lẫn AI.

Nói cách khác, cloud-native đang trưởng thành. Nó không còn chỉ là bộ công nghệ để đẩy phần mềm lên cloud nhanh hơn, mà đang trở thành lớp hạ tầng nền để doanh nghiệp vận hành nhiều loại workload phức tạp hơn trước, trong đó có AI.

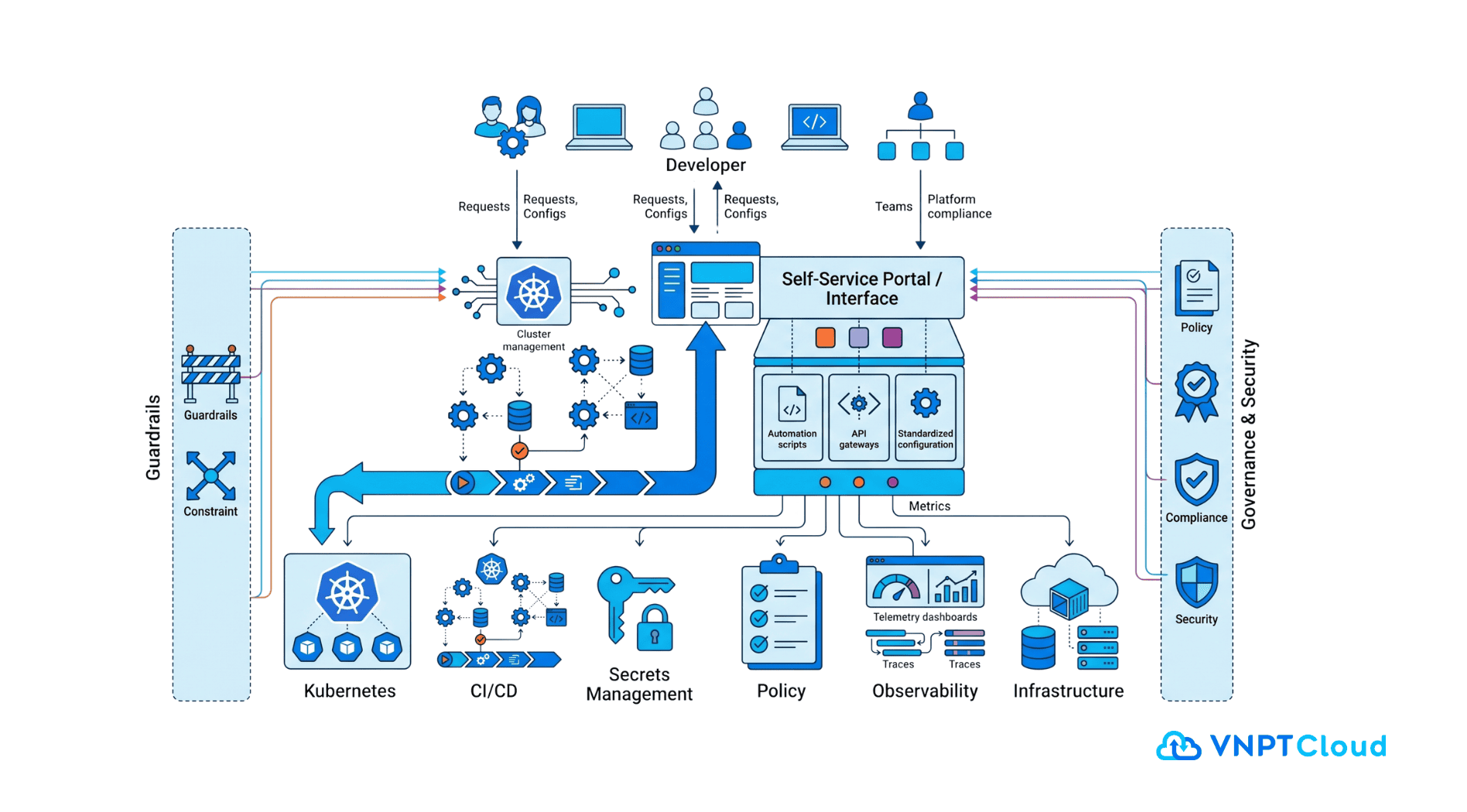

Vì sao platform engineering nổi lên đúng vào thời điểm này?

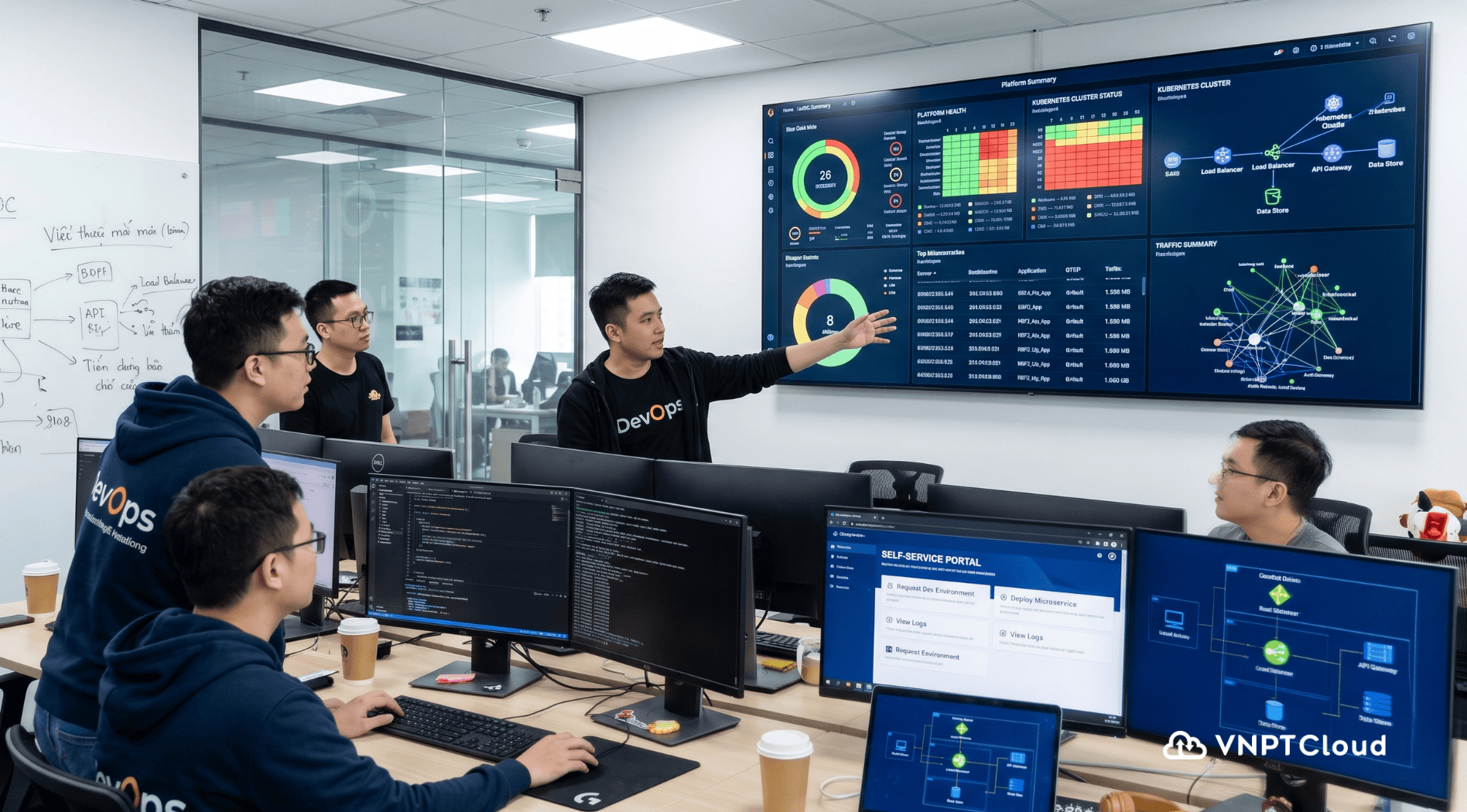

Khi cloud-native mở rộng, độ phức tạp hạ tầng cũng tăng theo. Một tổ chức không chỉ phải quản lý cluster, pipeline hay observability, mà còn phải xử lý policy, secrets, IAM, networking, self-service, cost visibility và bây giờ là thêm AI workloads. Nếu mỗi nhóm tự ghép từng mảnh công cụ theo cách riêng, kết quả rất dễ là một môi trường vừa khó vận hành vừa khó chuẩn hóa. Báo cáo State of Cloud Native Development Q1 2026 cho thấy 88% backend developers hiện làm việc trong các môi trường DevOps và platform đã được chuẩn hóa, phản ánh rất rõ xu hướng doanh nghiệp đang cố gắng giảm bớt phân mảnh vận hành.

Đó là lý do platform engineering được nhắc đến ngày càng nhiều. CNCF mô tả platform engineering là thực hành cung cấp các nền tảng tính toán cho developer và người dùng nội bộ thông qua sự kết hợp của con người, quy trình, chính sách, công nghệ và kết quả kinh doanh. White paper và maturity model của CNCF cũng nhấn mạnh rằng giá trị của nền tảng nội bộ không nằm ở việc gom nhiều công cụ lại với nhau, mà ở việc tạo ra trải nghiệm nhất quán, tuân thủ và dễ dùng để các nhóm triển khai sản phẩm nhanh hơn.

CNCF còn nói rất rõ mục tiêu chính của platform engineering là cải thiện developer experience (DevEx) và tối ưu hóa delivery. Nói dễ hiểu, nếu DevOps từng giúp kết nối phát triển và vận hành, thì platform engineering là bước tiếp theo: biến phần hạ tầng dùng chung thành một sản phẩm nội bộ có self-service, có guardrail và có “golden path” để developer đi nhanh hơn mà vẫn không phá vỡ tiêu chuẩn chung.

AI đang làm thay đổi bài toán của cloud-native như thế nào?

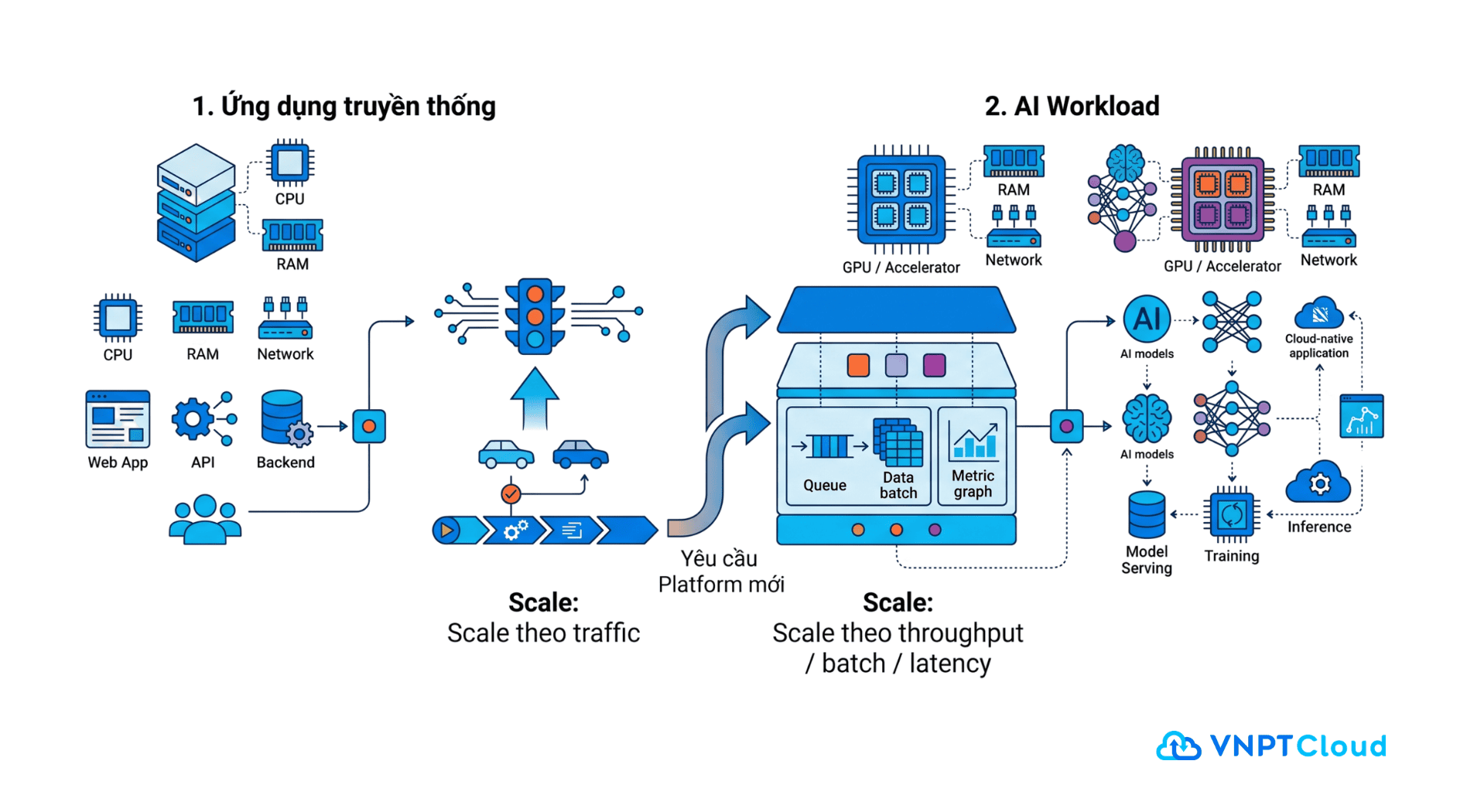

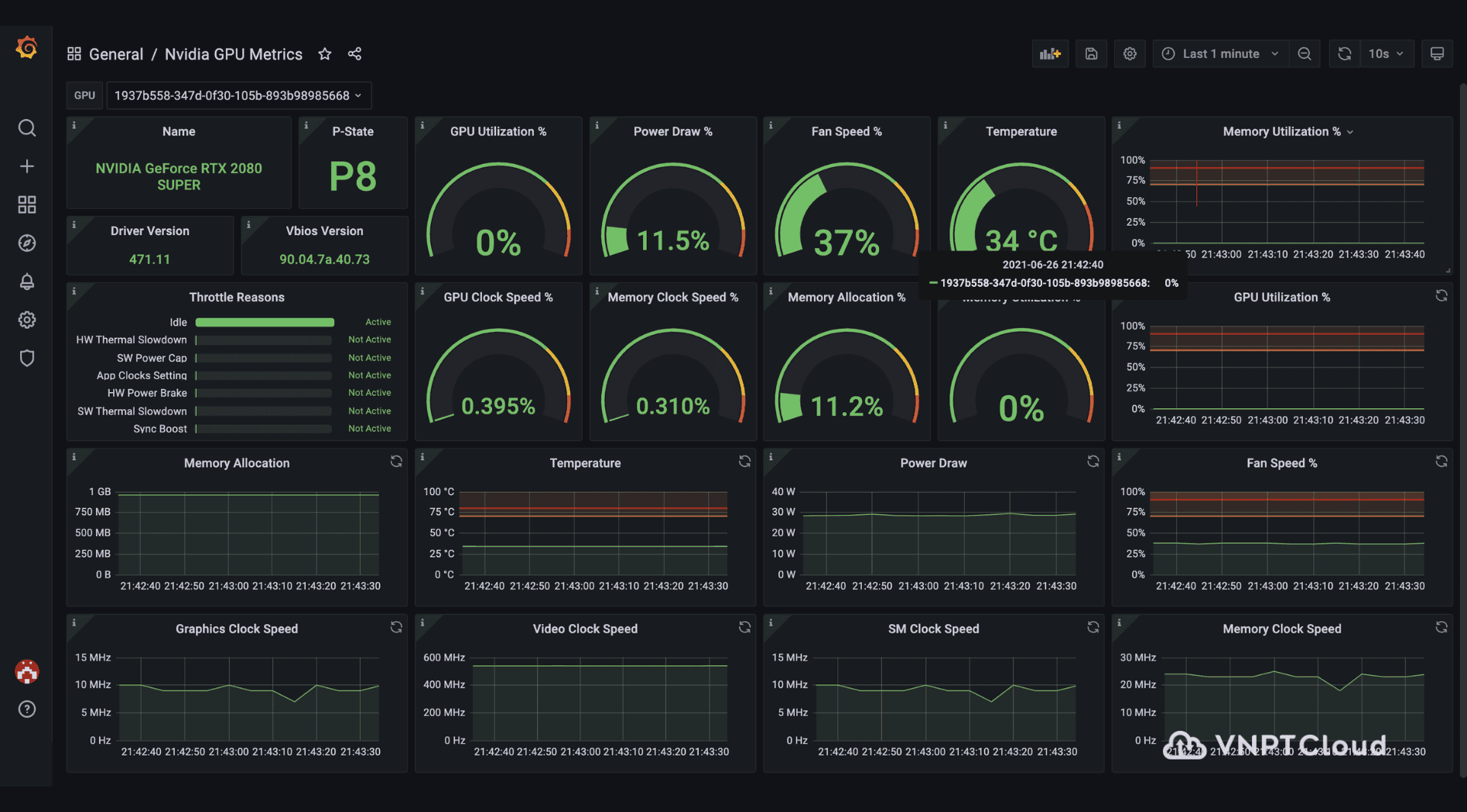

AI khiến bài toán hạ tầng trở nên khác hẳn so với thời cloud-native chỉ phục vụ microservices. Với ứng dụng truyền thống, doanh nghiệp chủ yếu tối ưu CPU, memory, network và storage. Nhưng với AI, đặc biệt là inference và training, câu chuyện bắt đầu xoay quanh GPU, accelerator, model artifact lớn, throughput, batch scheduling, cache, data pipeline và quan sát hiệu năng theo cách hoàn toàn khác. CNCF gọi đây là bài toán “the platform under the model”, tức là giá trị của AI production không chỉ nằm ở bản thân model, mà còn nằm ở nền tảng bên dưới model đó.

Đây là điểm nhiều tổ chức bắt đầu nhìn lại nền tảng cloud-native của mình. Một platform vốn chạy rất ổn cho web app và API chưa chắc đã sẵn sàng cho inference service, cho training job đa node hay cho việc phân bổ GPU theo nhiều kiểu workload khác nhau. Khi AI đi vào production, các điểm yếu cũ của platform bộc lộ rất nhanh: provisioning chậm, môi trường thiếu chuẩn, policy rời rạc, tài nguyên đặc thù khó chia sẻ, pipeline thiếu self-service và observability chưa đủ sâu. Đó là lý do AI không chỉ là một loại workload mới; nó còn là một “stress test” (phương pháp đánh giá khả năng hoạt động, độ bền của một hệ thống dưới áp lực cao nhất) cho toàn bộ mức trưởng thành của platform hiện tại.

Bởi vậy, cuộc gặp giữa cloud-native và AI không đơn giản là “chạy model trên Kubernetes”. Đằng sau nó là một thay đổi lớn hơn: doanh nghiệp đang phải tái thiết kế lại cách xây platform để AI có thể đi vào production một cách lặp lại được, kiểm soát được và mở rộng được.

Kubernetes đang tiến hóa để trở thành nền chung cho AI production

Một tín hiệu rất rõ là chính Kubernetes cũng đang tiến hóa theo hướng phù hợp hơn với AI. Trong Kubernetes 1.34, Dynamic Resource Allocation (DRA) đã lên GA, và project Kubernetes mô tả đây là framework cho phép quản lý linh hoạt các tài nguyên khan hiếm như GPU, TPU, FPGA, NIC và các thiết bị tăng tốc khác. DRA giúp workload không chỉ “xin N thiết bị”, mà còn có thể yêu cầu những đặc tính cụ thể của thiết bị, cấu hình theo nhu cầu và thậm chí hỗ trợ các mô hình chia sẻ tài nguyên tinh vi hơn.

Định nghĩa một số thuật ngữ:

- DRA - Dynamic Resource Allocation là một tính năng của Kubernetes cho phép bạn yêu cầu và chia sẻ tài nguyên giữa các Pod. Các tài nguyên này thường được gắn kèm thiết bị giống như các bộ tăng tốc phần cứng.

- GPU - Graphics Processing Unit - Bộ xử lý đồ họa là vi mạch chuyên dụng được thiết kế để tăng tốc xử lý, thao tác và tạo hình ảnh trong bộ đệm khung hình,

- TPU -Tensor Processing Unit (AI): Bộ xử lý chuyên dụng do Google phát triển để tăng tốc các tác vụ máy học (machine learning) và deep learning, đặc biệt tối ưu cho TensorFlow.

- FPGA - Field-Programmable Gate Array là mạch tích hợp cỡ lớn dựa trên ma trận các khối logic (CLB) có thể tái cấu hình, cho phép kỹ sư lập trình chức năng phần cứng sau khi sản xuất. Khác với CPU/GPU, FPGA tạo ra cấu trúc phần cứng tùy biến, mang lại sự linh hoạt cao, hiệu năng song song mạnh mẽ, phù hợp cho tạo mẫu thử và xử lý tốc độ cao.

- NIC - Network Interface Card là card mạng, linh kiện phần cứng (thẻ, card) cắm vào máy tính, máy chủ, hoặc tích hợp trên bo mạch chủ, giúp thiết bị kết nối internet hoặc mạng nội bộ LAN.

Điều này quan trọng vì AI không phải loại workload có nhu cầu hạ tầng đồng nhất. Một inference service, một training job phân tán và một agentic workflow có thể yêu cầu tài nguyên rất khác nhau. Khi DRA trưởng thành, Kubernetes tiến gần hơn đến vai trò nền tảng điều phối cho các tài nguyên phần cứng đắt đỏ và phức tạp, thay vì chỉ là nơi “xếp container lên node”. Với doanh nghiệp, đây là bước tiến rất lớn vì nó giúp việc quản lý GPU và accelerator đi theo mô hình cloud-native chuẩn hơn, ít phụ thuộc vào những workaround mang tính riêng lẻ.

Nói ngắn gọn, Kubernetes không “giảm hot”; nó đang trở nên nền tảng hơn. Nếu như giai đoạn đầu Kubernetes nổi lên nhờ khả năng chuẩn hóa triển khai ứng dụng, thì giai đoạn này nó nổi lên nhờ khả năng trở thành lớp substrate chung cho cả AI workloads trong production.

Các tiêu chuẩn và công cụ mới đang hình thành quanh AI-native platform

Một dấu hiệu trưởng thành khác của hệ sinh thái là cloud-native không chỉ có thêm workload AI, mà đang bắt đầu có tiêu chuẩn AI của riêng mình. Cuối năm 2025, CNCF công bố Certified Kubernetes AI Conformance Program để thiết lập một baseline chung cho việc chạy AI workloads trên Kubernetes, với mục tiêu giúp doanh nghiệp tự tin hơn khi triển khai AI và giúp các nền tảng có một mức tương thích tối thiểu chung. Đến tháng 3/2026, CNCF cho biết số nền tảng đạt chứng nhận gần như đã tăng gấp đôi, đồng thời bộ yêu cầu mới đang siết chặt hơn nhằm bảo đảm các workload AI phức tạp chạy ổn định và nhất quán hơn giữa các môi trường.

Song song với tiêu chuẩn là sự trưởng thành của bộ công cụ dành cho platform engineering. Báo cáo CNCF Technology Radar Q1 2026 cho thấy trong nhóm application delivery, Helm, Backstage và kro là ba công nghệ được đặt vào vị trí Adopt; CNCF cũng nhấn mạnh đây là những công cụ mà cộng đồng developer đánh giá là trưởng thành, hữu ích và sẵn sàng cho triển khai rộng rãi. Điều này nói lên một điều rất quan trọng: platform engineering không còn là phần “tự chế” trong từng công ty, mà đang có một lớp công cụ và mô hình đủ trưởng thành để doanh nghiệp dựa vào.

Một ví dụ rất đáng chú ý nữa là llm-d được CNCF chấp nhận vào Sandbox trong tháng 3/2026. CNCF mô tả llm-d như một bước tiến để đưa Kubernetes thành nền AI infrastructure hiện đại hơn; còn Google Cloud gọi đây là tầm nhìn “any model, any accelerator, any cloud”. Chỉ riêng cụm này đã cho thấy hướng đi của thị trường: thay vì xây những stack AI đóng kín và khó di chuyển, cộng đồng cloud-native đang cố đẩy AI production về một mặt bằng mở hơn, chuẩn hóa hơn và ít khóa nhà cung cấp hơn.

Vậy điều này có ý nghĩa gì với doanh nghiệp?

Theo tôi, điều quan trọng nhất là doanh nghiệp không nên xem AI như một “dự án riêng” hoàn toàn tách khỏi platform hiện tại. Khi CNCF cho thấy ngày càng nhiều tổ chức chạy inference trên Kubernetes, và khi các tiêu chuẩn AI conformance bắt đầu hình thành, thông điệp rất rõ là AI đang được kéo vào cùng quỹ đạo vận hành của cloud-native thay vì trở thành một thế giới riêng.

Vì vậy, câu hỏi doanh nghiệp nên tự đặt ra không phải chỉ là “đã có cụm GPU chưa” hay “đã thử model nào rồi”, mà là: platform hiện tại đã sẵn sàng hấp thụ AI chưa? Nếu đội sản phẩm muốn deploy inference service, đội dữ liệu muốn chạy batch AI job, đội bảo mật muốn gắn policy, còn đội vận hành muốn quan sát chi phí và hiệu năng của AI workload, liệu tất cả có cùng đi qua một nền tảng có chuẩn chung hay vẫn phải “mỗi đội tự xoay”? Phần lớn giá trị của platform engineering nằm ở chỗ trả lời được câu hỏi này bằng một “có” đáng tin cậy.

Với các tổ chức đang ở giai đoạn đầu, điều đó không nhất thiết có nghĩa là phải xây ngay một AI platform lớn. Nhưng nó có nghĩa là nên đầu tư sớm vào những thành phần nền tảng: self-service, chuẩn hóa môi trường, policy-as-code, khả năng quản trị tài nguyên chuyên biệt, observability đủ sâu và một internal developer platform có thể mở rộng sang nhu cầu AI khi cần. Đây là cách tiếp cận thực tế hơn rất nhiều so với việc mua thêm công cụ mà chưa giải quyết được nền tảng bên dưới.

Kết luận

Cloud-native đang bước vào một pha mới. Giai đoạn đầu là học cách chạy ứng dụng hiện đại trên container và Kubernetes. Giai đoạn tiếp theo là xây platform để giảm độ phức tạp và chuẩn hóa cách developer tương tác với hạ tầng. Còn giai đoạn đang diễn ra bây giờ là dùng chính platform đó để vận hành AI theo cách có kiểm soát, có tiêu chuẩn và có khả năng mở rộng. Tất cả những tín hiệu lớn nhất từ CNCF trong đầu năm 2026, từ quy mô cộng đồng developer, mức độ production của Kubernetes, xu hướng platform engineering cho đến các tiêu chuẩn AI conformance đều đang chỉ về cùng một hướng.

Nếu phải tóm lại trong một câu, tôi sẽ nói thế này:

Giai đoạn đầu của cloud-native là hiện đại hóa ứng dụng; giai đoạn tiếp theo là xây nền tảng; còn giai đoạn hiện tại là dùng nền tảng đó để 'hấp thụ' AI mà không làm doanh nghiệp cuốn vào những khó khăn, phức tạp mới.

Tổ chức nào nhận ra điều này sớm sẽ không chỉ triển khai nhanh hơn, mà còn tránh được rất nhiều chi phí sửa sai khi AI đi vào production ở quy mô lớn hơn trong vài năm tới.

Bài viết này có tham khảo thông tin từ https://www.cncf.io/; https://kubernetes.io/; ... Và các hình minh hoạt có sử dụng AI.